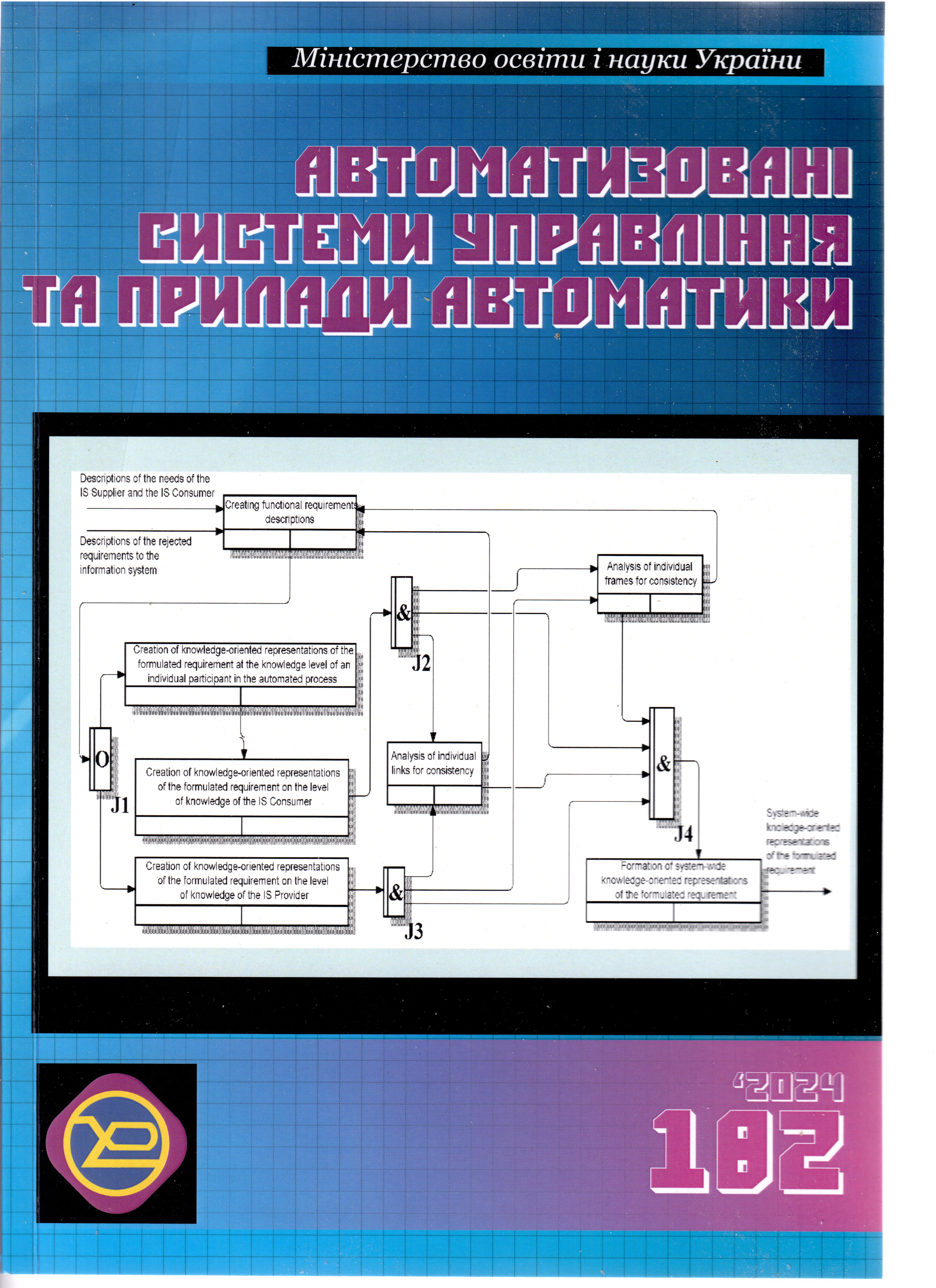

Уточнення ментальної моделі рішення на основі доповнення вхідних даних в задачі формування пояснень в інтелектуальній системі

DOI:

https://doi.org/10.30837/0135-1710.2024.182.066Ключові слова:

пояснення, інтелектуальна система, самопояснювальний штучний інтелект, система штучного інтелекту, ментальна модель, користувачі інтелектуальної системи, доповнення вхідних данихАнотація

Предметом дослідження є процес побудови ментальної моделі рішення для користувача інтелектуальної системи. Метою є розробка підходу до уточнення ментальної моделі користувача на основі принципу доповнення вхідних даних для того, щоб врахувати як позитивні, так і негативні аспекти рішення. Задачі: структуризація принципу доповнення вхідних даних; розробка методу уточнення ментальної моделі користувача інтелектуальної системи на основі доповнення вхідних даних. Наукова новизна отриманих результатів полягає в такому. Удосконалено принципи побудови ментальних моделей з урахуванням особливостей формування пояснень в інтелектуальних системах. Запропоновано метод уточнення ментальної моделі на основі аналізу відгуків користувачів, що дозволяє доповнити модель негативними властивостями рішення. Метод містить етапи аналізу відгуків користувачів, оцінки важливості виявлених властивостей рішення, доповнення ментальної моделі з урахуванням негативних властивостей та балансування позитивних і негативних аспектів рішення. Використання даного методу при побудові пояснення дає можливість формувати повніші та збалансованіші пояснення, які враховують як переваги, так і обмеження рішення інтелектуальної системи. Експериментальна перевірка запропонованого методу показала можливість автоматизованого доповнення ментальної моделі рішення на основі аналізу відгуків користувачів інтелектуальної системи.

Посилання

Adadi, A., & Berrada, M. (2018). Peeking inside the black-box: A survey on Explainable Artificial Intelligence (XAI). IEEE Access, 6, 52138-52160. https://doi.org/10.1109/ACCESS.2018.2870052.

Gunning, D., & Aha, D. W. (2019). DARPA’s Explainable Artificial Intelligence (XAI) program: A retrospective. AI Magazine, 40(2), 44-58. https://doi.org/10.1609/aimag.v40i2.2850.

Rook, L. (2021). Mental models: A robust definition. The Learning Organization, 28(1), 6-17. https://doi.org/10.1108/TLO-09-2019-0136.

Byrne, R. M. (2002). Mental models and counterfactual thoughts about what might have been. Trends in Cognitive Sciences, 6(10), 426-431. https://doi.org/10.1016/S1364-6613(02)01974-5.

Ribeiro, M. T., Singh, S., & Guestrin, C. (2016). «Why should I trust you?»: Explaining the predictions of any classifier. Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining, 1135-1144.

Lundberg, S. M., & Lee, S. I. (2017). A unified approach to interpreting model predictions. Advances in Neural Information Processing Systems, 30, 4765-4774.

Samek, W., Montavon, G., Lapuschkin, S., Anders, C. J., & Müller, K. R. (2022). Explaining deep neural networks and beyond: A review of methods and applications. Proceedings of the IEEE, 109(3), 247-278.

Чалий С. Ф., Лещинський В. О. Темпорально-каузальні методи побудови пояснень в системах штучного інтелекту. АСУ та прилади автоматики. Вип. 181. 2024. С. 91-99. DOI: 10.30837/0135-1710.2024.181.091.

Чалий С. Ф., Лещинський В. О. Побудова пояснень на локальному рівні представлення процесу формування рішень для внутрішніх користувачів інтелектуальної системи. Біоніка інтелекту, 2024. Т. 1 (100). С. 58-64. DOi 10.30837/ bi.2024.1(100).08.

Чалий, С., Лещинський, В., & Лещинська, І. (2022). Каузальна модель процесу побудови пояснень в інформаційній системі. Системи управління, навігації та зв'язку, 3(69), 99-103. https://doi.org/10.26906/SUNZ.2022.3.099.

Miller, T. (2019). Explanation in artificial intelligence: Insights from the social sciences. Artificial Intelligence, 267, 1-38.

Johnson-Laird, P. N. (1983). Mental models: Towards a cognitive science of language, inference, and consciousness. Harvard University Press.

Johnson-Laird, P. N. (2006). How we reason. Oxford University Press/

Чалий, С. Ф., & Лещинська, І. О. (2024). Принципи побудови ментальних моделей рішення для зовнішнього користувача в задачі формування пояснень в інтелектуальній системі. АСУ і прилади автоматики, (181), 17-25.

Norman, D. A. (2014). Some Observations on Mental Models. In D. Gentner & A. L. Stevens (Eds.), Mental Models (pp. 7-14). Psychology Press.

Чалий, С., & Лещинська, І. (2023). Концептуальна ментальна модель пояснення в системі штучного інтелекту. Вісник Національного технічного університету «ХПІ». Серія: Системний аналiз, управління та iнформацiйнi технологiї, (1 (9), 70–75. https://doi.org/10.20998/2079-0023.2023.01.11

Gentner, D., & Stevens, A. L. (2014). Mental models. Psychology Press.

Pearl, J., & Mackenzie, D. (2018). The book of why: the new science of cause and effect. Basic Books.

Bansal, G., Nushi, B., Kamar, E., Lasecki, W. S., Weld, D. S., & Horvitz, E. (2019). Beyond accuracy: The role of mental models in human-AI team performance. Proceedings of the AAAI Conference on Human Computation and Crowdsourcing, 7(1), 2-11.

Lipton, Z. C. (2018). The mythos of model interpretability. Queue, 16(3), 31-57.

UA

UA  EN

EN