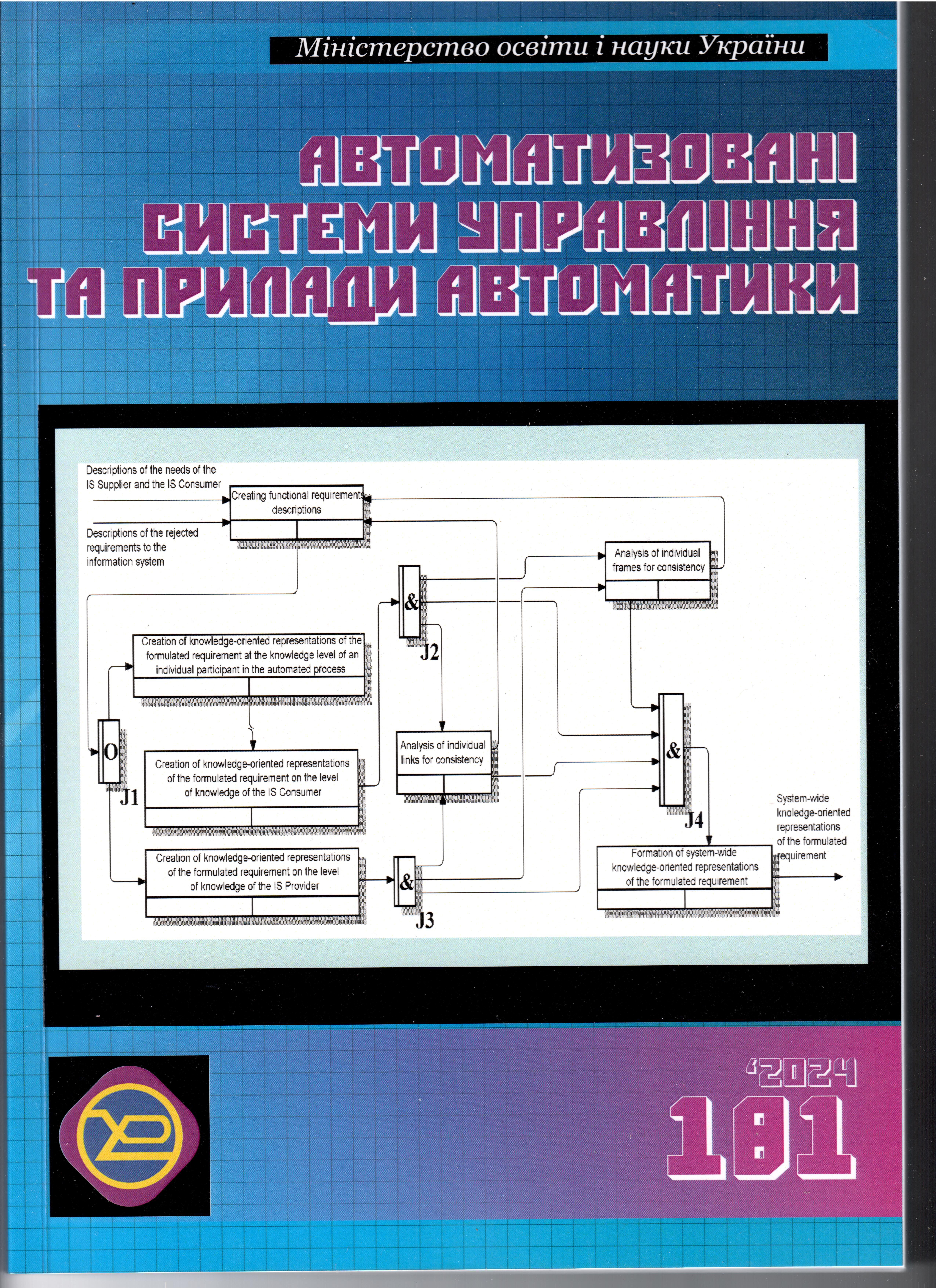

Темпорально-каузальні методи побудови пояснень в системах штучного інтелекту

DOI:

https://doi.org/10.30837/0135-1710.2024.181.091Ключові слова:

пояснення, інтелектуальна система, самопояснювальний штучний інтелект, темпоральна залежність, каузальна залежність, можливість, система штучного інтелектуАнотація

Предметом дослідження є процес побудови пояснень в системах штучного інтелекту. Метою є розробка темпорально-каузального підходу до побудови пояснень в системах штучного інтелекту з тим, щоб представити пояснення як щодо процесу прийняття рішення, так і щодо отриманого рішення та зробити їх прозорими та зрозумілими для вирішення практичних завдань користувачів. Задачі: структуризація рівнів представлення пояснень з урахуванням темпорального й каузального аспектів; розробка узагальненого методу побудови пояснень з використанням темпоральних та каузальних залежностей; розробка методу уточнення пояснень з використанням темпоральних залежностей. Виконано структуризацію представлення пояснення у темпоральному на каузальному аспектах на локальному, проміжному та глобальному рівнях. Наукова новизна отриманих результатів полягає в такому. Запропоновано темпорально-каузальний метод побудови пояснень, що містить етапи побудови темпоральних та каузальних залежностей на локальному, проміжному та глобальному рівнях представлення пояснень. Метод дає можливість на основі темпоральних залежностей сформувати пояснення у формі каузальних залежностей, які визначають дії процесу та значення вхідних змінних як причини отриманого рішення, що створює умови для підвищення рівня довіри користувачів. Розроблено метод побудови пояснень на глобальному рівні представлення на основі упорядкованості вхідних даних. Метод містить етапи побудови темпоральних правил, визначення ваг правил на основі ваг антецедента та консеквента, побудови каузальних правил, побудови пояснення як сукупності зважених каузальних правил, що дає можливість врахувати структуру вхідних даних при побудові пояснення.

Посилання

Bansal, G., Wu, T., Zhou, J., Fok, R., Nushi, B., Kamar, E., Ribeiro, M. T., & Weld, D. S. (2021). Does the whole exceed its parts? The effect of AI explanations on complementary team performance. Proceedings of the 2021 CHI Conference on Human Factors in Computing Systems, 1-16. doi: https://doi.org/10.1145/3411764.3445717

Adadi, A., & Berrada, M. (2018). Peeking inside the black-box: A survey on Explainable Artificial Intelligence (XAI). IEEE Access, 6, 52138-52160. https://doi.org/10.1109/ACCESS.2018.2870052

Miller, T. (2019). Explanation in artificial intelligence: Insights from the social sciences. Artificial Intelligence, 267, 1-38. doi: https://doi.org/10.1016/j.artint.2018.07.007

Byrne, R. M. (2019). Counterfactuals in explainable artificial intelligence (XAI): Evidence from human reasoning. Proceedings of the Twenty-Eighth International Joint Conference on Artificial Intelligence (IJCAI-19), 6276-6282. doi: https://doi.org/10.24963/ijcai.2019/876

Chalyi, S., Leshchynskyi, V., & Leshchynska, I. (2019). Method of forming recommendations using temporal constraints in a situation of cyclic cold start of the recommender system. EUREKA: Physics and Engineering, 4, 34-40. doi: https://doi.org/10.21303/2461-4262.2019.00952

Chala O. (2018) Models of temporal dependencies for a probabilistic knowledge base. Econtechmod. An International Quarterly Journal, 7, 3, 53 – 58.

Chalyi, S., & Leshchynskyi, V. (2020). Temporal representation of causality in the construction of explanations in intelligent systems. Advanced Information Systems, 4(3), 113-117. doi: https://doi.org/10.20998/2522-9052.2020.3.16

Hoffman, R. R., Klein, G., & Miller, J. M. (2011). Naturalistic investigations and models of reasoning about complex indeterminate causation. Information Knowledge Systems Management, 10(1-4), 397-425. doi: https://doi.org/10.3233/IKS-2012-0203

D. Gunning і D. Aha, (2019). DARPA’s Explainable Artificial Intelligence (XAI) Program. AI Magazine, 40(2), 44-58. doi: https://doi.org/10.1609/aimag.v40i2.2850

Hanif, A. et al. (2023). A Comprehensive Survey of Explainable Artificial Intelligence (XAI) Methods: Exploring Transparency and Interpretability. Web Information Systems Engineering – WISE 2023. WISE 2023. Lecture Notes in Computer Science, 14306. Springer, Singapore. doi: https://doi.org/10.1007/978-981-99-7254-8_71

Yang, W., Wei, Y., Wei, H. et al. (2023). Survey on Explainable AI: From Approaches, Limitations and Applications Aspects. Hum-Cent Intell Syst, 3, 161–188. doi: https://doi.org/10.1007/s44230-023-00038-y

Ribeiro, M. T., Singh, S., & Guestrin, C. (2016). «Why should I trust you?» Explaining the predictions of any classifier. Proceedings of the 22nd ACM SIGKDD international conference on knowledge discovery and data mining, 1135-1144. doi: https://doi.org/10.1145/2939672.2939778

Lundberg, S. M., & Lee, S. I. (2017). A unified approach to interpreting model predictions. In Advances in neural information processing systems. 4765-4774.

Чалий С. Ф., Лещинський В. О., Лещинська І. О. (2021). Контрфактуальна темпоральна модель причинно-наслідкових зв'язків для побудови пояснень в інтелектуальних системах. Вісник Національного технічного університету «ХПІ». Сер. : Системний аналіз, управління та інформаційні технології = Bulletin of the National Technical University «KhPI». Ser.: System analysis, control and information technology : зб. наук. пр. Харків: НТУ «ХПІ», 2 (6), 41-46.

Chalyi, S., & Leshchynskyi, V. (2020). Causal reasoning in the construction of explanations in intelligent systems. Advanced Information Systems, 4(4), 105-110. doi: https://doi.org/10.20998/2522-9052.2020.4.14

Chala O. (2018). Models of temporal dependencies for a probabilistic knowledge base. Econtechmod. An International Quarterly Journal, 7, 3, 53–58.

Levykin V., Chala O. (2018). Development of a method of probabilistic inference of sequences of business process activities to support business process management. Eastern-European Journal of Enterprise Technologies, 5/3(95), 16-24. doi: 10.15587/1729-4061.2018.142664

Чала О. В. (2020) Модель узагальненого представлення темпоральних знань для задач підтримки управлінських рішень. Вісник Національного технічного університету «ХПІ». Системний аналіз, управління та інформаційні технології. № 1(3). С. 14-18. doi: 10.20998/2079-0023.2020.01.03.

Chalyi, S., & Leshchynskyi, V. (2020). Causal reasoning in the construction of explanations in intelligent systems. Advanced Information Systems, 4(4), 105-110. doi: https://doi.org/10.20998/2522-9052.2020.4.14

Chalyi, S., & Leshchynskyi, V. (2021). Hierarchical representation of causal relationships to detail explanations in intelligent systems. Advanced Information Systems, 5(4), 103-108. doi: https://doi.org/10.20998/2522-9052.2021.4.14

Byrne, R. M. (2005). The rational imagination: How people create alternatives to reality. MIT press. https://doi.org/10.7551/mitpress/5756.001.0001

Sloman, S. A. (2005). Causal models: How people think about the world and its alternatives. Oxford University Press. doi: https://doi.org/10.1093/acprof:oso/9780195183115.001.0001

UA

UA  EN

EN